頭で念じればコンピューターが動く…「カンタン革命」が進行中

睡眠中に「暑くて寝苦しい」と感じたらエアコンの冷房が効き始め、起床直後に「和食が食べたい」と思ったら、ロボットがご飯と味噌汁を用意してくれる――。近い将来、こんなSF映画のような生活が現実のものになるかもしれない。すでにスマートフォン(スマホ)やタブレット(多機能携帯端末)の普及で簡単なタッチや音声で命令を入力できるようになり、身ぶりや音声、視線で機器を操作する技術も登場している。そして次は「脳で念じれば……」という時代だ。人がコンピューターを思いのままに動かす「カンタン革命」が起きつつある。

脳波で身の回りのことを実行

京都府精華町にある国際電気通信基礎技術研究所(ATR)。2012年11月、1台の「最先端電動車いす」が始動した。

普通の住居を模した部屋の中では、車いすに座った被験者が、カーテンやドアの開閉、照明のオンオフなどを脳波で動かす実験が繰り返されている。被験者はアタマにベルト状の「脳計測計」を取り付け、「カーテンを開けたい」と念じる。すると、脳波のデータが車いすの装置から無線で部屋内のセンサーに送られ、カーテンを開閉するモーターを動かす仕組みだ。

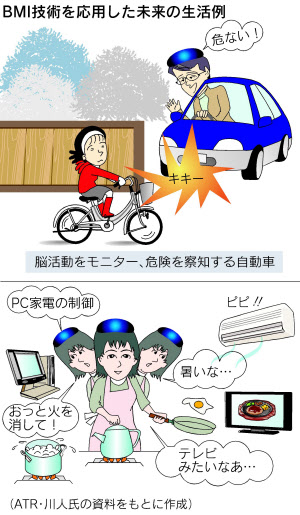

「念じてモノを動かす」という超能力のようなことを実現するのが「BMI(ブレイン・マシン・インタフェース)」と呼ばれる技術。ATRが作った「BMIハウス」は屋内には50の超音波位置センサー、物体の有無を調べる約5000個のセンサー、19台のカメラや8個のマイクなどを装備している。

被験者の位置や温度や照度などのデータを常時計測できるようになっている。ハウス内には集めたデータを処理するデータセンターも完備、脳が活動する際に発生する脳波データを蓄積したデータベースから必要な情報をリアルタイムで検索できる。

BMIハウスのプロジェクト(総務省の委託研究)には、積水ハウスや島津製作所、慶応義塾大、NTT先端技術総合研究所が参加している。実際に被験者は、事前に数週間かけて脳波を測定。そのデータを基に家電や車いすの動きを制御する実験を行う。

現時点では、被験者の脳波データはいったん東京のNTT武蔵野研究開発センタに送信して解析。その後、再びBMIハウスに戻す。脳の信号を計測・解読するのに6秒、近赤外分光の場合は約13秒ほどかかる。

実験では「テレビの電源を入れたい」と考えても瞬時に電源が入るわけではなく、指令通りに操作できる確率は7~8割という。精度向上と脳波計測時間の短縮など課題も多い。

医療用分野での存在意義高まる

ATRでは今後より多くの人を対象にした実験を計画。「今年度末までには、脳からの指令に対する正答率を7割にし、15年3月ごろには脳や生体情報を組み合わせ、快適・不快などのコミュニケーションができるようにする。早期に実用化への道筋を示したい」。プロジェクトを統括するATRの石井信・動的脳イメージング研究室長はこう意欲をみせる。

BMI研究の第一人者でもあるATRの脳情報研究所長の川人光男氏は「BMIハウスはビッグデータやICT(情報通信技術)と組み合わせることで、新たなイノベーションの中心を担う。産業への応用を進めれば、脳科学自体も発展する」と期待を寄せる。

川人氏は09年、ホンダ、島津製作所と共同で「二足歩行ロボット『ASIMO』を念じて動かす」という実験を成功させた。「13年以降、BMIは夢物語ではなく医療用分野で存在意義がはっきりしてくる。アプリケーションの数も飛躍的に伸びており、将来は自宅の健康機器のように、誰もが扱える汎用的な技術に育てたい」という。

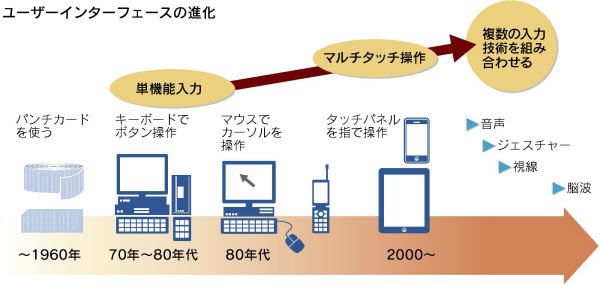

人と機械をつなぐユーザーインターフェース(UI)時代によって形を変えてきた。パンチカードなどでデータや命令を入力する方式に始まり、1990年代以降はマウスとカーソル、アイコン(絵文字)で操作する「グラフィカル・ユーザー・インターフェース(GUI)」が主流に。07年には指先でタッチすることで簡単かつ直感的に扱える「iPhone」が登場してユーザーの裾野は広がっている。

ここにきて「GUIの進化は、一種のプラトー(停滞)状態に入った」(自動車や家電メーカーなどのUIを手掛けるタクラム・デザイン・エンジニアリングの田川欣哉氏)という。GUIだけでは、劇的な操作性の改善が望めないからだ。

だからこそジェスチャーや音声、視線検知など、人が機械に触れることなく「対話」できる技術の開発が進んでいるわけだ。そして、指や発声などをつかさどる脳から直接その指令を読み取り、機械などの制御につなげようというのがBMI技術だ。

500種類以上のメッセージを脳波で伝達

12年12月中旬、東京・武蔵村山市の村山医療センター。胸から下が動かない患者を対象にした新たな実験が始まった。ATRが開発した「外骨格ロボット」を装着してもらい、患者が「右」「左」と念じると、その脳波情報に応じてロボットの6関節の駆動装置が動き、歩行や立ち上がりを支援する。患者への安全性の確認に関して、村山医療センターの協力を得ながら、患者の機能を再建する訓練への応用を目指す考えだ。

ATRの野田智之研究員は「この実験は第一歩のスタート。患者さんの体の一部として安全・快適に動かせるかどうかなど課題はあるが、5年以内には実際の回復訓練に活用できるようにしたい」と話す。

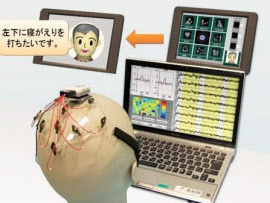

「和食を食べたい」「寝がえりを打ちたい」……。こうした500種類以上のメッセージを脳波で伝えることができる「ニューロコミュニケーター」と呼ぶ装置も、製品化の一歩手前の段階まできた。ALS(筋萎縮性側索硬化症)患者など身体が自由に動かせない人の生活支援を目指したもので、産業技術総合研究所が開発に取り組んでいる。

小型の脳波計を装着した患者がパソコンの画面に表示される「飲食する」「移動する」などの中から選ぶと、家族や介護者に意志を伝達できる。産総研ニューロテクノロジー研究グループの長谷川良平氏は「1~2年以内に協力企業からの製品化を目指している。家庭に体重計、体温計などがあるように身近な装置として健康器具・生活支援の道具として使ってもらいたい」と期待する。この装置が実用化されれば、全国の数万~数十万人の患者が家族や介護者と意思疎通できるようになるという。

脳の血流変化に伴う物理現象を測定する技術としては、すでにfMRI(機能的磁気共鳴画像装置)やNIRS(近赤外分光計測)、脳波計(EEG)、脳磁図(MEG)などがある。

超高齢化社会をにらみ産業応用が活発に

元来、米国では軍事用途としてBMIの技術開発が進められてきた。ATRの川人氏によると、頭で考えただけでコンピューターのカーソルやロボットを動かす「テレキネシス」や1万キロメートル離れた場所にいるロボットを動かす「テレポーテーション」、被験者の主観的な認知を読み取る「テレパシー」、脳の活動から映像を取り出す「念写」は、BMI技術で実現しているという。

川人氏は産業応用を期待する一方、「戦争や犯罪に使ってはいけない、本人の意志に反して心を読んだりしてはいけないなどの倫理的な規範が重要」と警告する。脳から直接情報を取ったり、遠隔で機器を自在に操ったりなど、BMI技術の普及にはリスクも伴うが、超高齢化を迎えようとする日本をはじめ医療分野向けなど産業への応用が活発になっている。

2年前には産学協同の研究組織「応用脳科学コンソーシアム」が発足。今では日産自動車や東芝、NEC、ヤマハ発動機、パナソニックなどが参加を表明し、参画企業数は40社近くまで増加している。

脳情報を検出して自動で操縦できる自動車や、考えただけで通信可能なモバイル機器、運転中の覚醒度をフィードバックする装置など、「日本メーカーは技術開発に本格的に力を入れ始めた」(同コンソーシアム運営を務めるNTTデータ経営研究所・マネジメントイノベーションセンター長の萩原一平氏)という。計測分野では、日立製作所や島津、浜松ホトニクスが医療機器分野などのBMIの研究蓄積を生かして用途拡大を目指す。

究極のUIは脳に注目したBMIだけではない。眼球の動きなど人体からの微妙な変化という「信号」をとらえ、パソコンやタブレットの操作に役立てようという研究も活発になっている。

見たい部分を先回りして表示

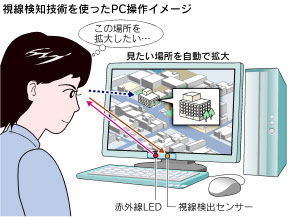

「ユーザーの見たい部分をパソコンが先回りして表示できるようになった」。こう話すのは富士通研究所イメージコンピューティング研究部の清水雅芳部長だ。富士通は12年秋に発売したパソコンに、この視線検出技術を搭載している。

微弱な発光ダイオード(LED)照明をユーザーの目に照射し、角膜の反射と瞳孔の位置をカメラでとらえて視線を検出し、視線の方向を割り出す仕組みだ。視線の動きにあわせて画面をスクロールしたり、拡大したりできる。ウィンドウズ8の操作の入り口である「チャーム」をユーザーが見ると、先回りしてその操作の入り口を大きく表示できたりもする。

富士通研は画像処理技術を車のナンバープレートの認識などにも応用。パソコンに内蔵する小型カメラと近赤外線LEDを組み合わせ、不鮮明な画像からでも瞳孔と角膜反射を正確に検出できるようにした。「運転者の身体状況を正確に把握したい」という自動車メーカーなどからも問い合わせを受けているという。

NTTドコモも視線の動きでタブレットを操作できる技術を開発中だ。赤外線照射装置をタブレットに取り付け、赤外線を目に当てた時の反射から視線の動きを検知する。目の動きに合わせてページをめくるなど、タッチパネルを操作できるという。

眼球の動きに着目し、メガネで情報の入出力を行わせようとしているのは米グーグルだ。スマホの次のUIとしてメガネ型ディスプレーを開発中で、メガネ端末を装着するとレンズ上に検索結果や受信メール、地図などが表示される。

産業への応用を狙っている研究機関や企業ばかりではない。NPO団体「ラボツネ」は昨年9月、生体機能を使ったインターフェースの開発と応用に向けた活動を始めた。

まず、眼球が動くときに発声する眼電位などを計測する4つのセンサーがつく装置を頭につけ、眼球の動きや歯ぎしりなどで車いすを操縦する電動車椅子システムを開発。13年以降、福祉施設などで障害がある人たちに使ってもらい実験を進める。

注目集める「マルチモーダル」

ラボツネの構成員は大手自動車メーカーで技術開発に携わる青木治雄氏ら。青木氏は「脳波の測定精度や被験者自身が事前に訓練しなければならないなどまだ制約が多い。まずは眼球などを使って人間と機械をつなぐための実験を進める」という。開発したソフトウエアや電動車椅子システムを広く普及させるため、設計図などの公開も検討している。

音声や視覚、脳波などを検知する様々なUIが登場しつつあるが、それらを統合して利用する「マルチモーダル」という手法も注目されている。あるときは脳波で情報を入力し、あるときは聴覚で情報を出力するなど、ユーザーがどんな状態でも「自然な形で機器とつながることができる技術」である。

テレビやカーナビ、携帯電話やパソコンを含めた日本の電子機器市場は12年で20兆円。経済産業省の試算で国内の自動車産業全体の市場規模は約47兆円。介護・福祉ロボットも将来の有望産業であり、こうした分野にBMIなど最先端のUIが利用されれば、さらに市場拡大が期待できる。

総務省は「脳の仕組みを活かしたイノベーション創成型研究開発」の調査・実験に取り組んでいる。その応用範囲は幅広い。

「耳にかけたセンサーで脳の活動を調べ、行き先を瞬時に探すカーナビ」「思い浮かんだ言葉をメール文に変える携帯電話」「寒いと感じたら動く空調機」「見たいときだけうつるテレビ」「子どもの理解度を確かめながら教える教師ロボット」……。これら夢のような技術を産学官が連携し、20年までに実用化することを目標に掲げている。

無限に広がるUIの近未来。理化学研究所で脳信号処理研究を担当するアンジェイ・チホツキ氏の研究室はその一端を担っている。脳波を使って人がロボットや車いすを制御する技術を応用し、2人の脳をロボット経由で対話させたり、同期させたりする研究に乗り出している。

脳科学研究予算、米は日本の20倍

「ロボット制御」という枠を超え、音楽を聴いたり、映画を見たりしながら感情のやりとりをして人間同士の相互理解を深めることにつなげたい考えだ。チホツキ氏は「BMI技術はゲームや教育、芸術など様々な分野に広がっていく」と予想する。

しかし日本の脳科学研究は決して層が厚いわけではない。米国は研究人員の数が日本の8倍、予算は20倍で、がん研究やヒトゲノムに匹敵する規模だ。中国、韓国、シンガポールなどアジア各国でも同分野の研究は加速している。グーグルやマイクロソフトだけでなく、自動車、娯楽、日用品の業界に至るまで、「世界中のグローバル企業で脳科学の応用を研究していないところはない」といわれるほどだ。

「人」とパソコンなどの「機械」を隔てていた距離を一気に縮める究極のUIを目指して、産学官の動きはますます活発になりそうだ。

(電子報道部 杉原梓)

![図1 従来のリモコンやキーボード、マウスなどとは異なる入力技術の開発や提案が相次いでいる。[1]はAppleの携帯端末向け音声入力UI「Siri」。[2]と[3]は、それぞれイスラエルPrimeSenseとSamsungによるテレビ向けジェスチャー入力UIのデモ。[4]と[5]は、それぞれ東芝と富士通のジェスチャー入力UI。[6]はスウェーデンTobii Technologyが開発した、Windows 8ベータ版に対応したパソコン向け視線入力技術のデモ](https://article-image-ix.nikkei.com/https%3A%2F%2Fimgix-proxy.n8s.jp%2FDSXZZO4739746018102012000000-47.png?ixlib=js-3.8.0&w=175&h=109&auto=format%2Ccompress&fit=crop&bg=FFFFFF&s=7b1aec21fba0edaeb67918d8067c526c)